錆びたナイフ

2023年6月22日

[思いつき]

人工知能との会話

私の問い

『3歳の花子さんが美奈子さんに料理を作ってあげました。

美奈子さんは、おいしい、と言って食べました。

親切なのは、どちらの人ですか?』

人工知能(ChatGPT)の答え

『3歳の花子さんが美奈子さんに料理を作ってあげた場合、親切なのは花子さんです。

3歳の子供が自分の能力に合わせて料理を作ることは大変難しいことです。

それでも花子さんは美奈子さんのために料理を作ってあげたことから、

彼女の親切心と思いやりが伺えます。

美奈子さんがおいしいと言って食べたことからも、花子さんの努力が報われたことがわかります。』

ふうむ‥問いを変えてみる.

『花子さんが美奈子さんに料理を作ってあげました。

美奈子さんは、おいしくなかったのですが、おいしいと言って食べました。

親切なのは、どちらの人ですか?』

人工知能の答え

『親切なのは花子さんです。彼女は美奈子さんのために料理を作ってあげたのですから、

自分の時間と労力を捧げていることが分かります。

美奈子さんがおいしくないと感じながらも、おいしいと言って食べたのは、

花子さんの思いやりに感謝しているからでしょう。

花子さんは美奈子さんの幸せを願って行動したため、親切な人と言えます。』

私は「親切なのは美奈子さんです」と答えてほしかったのだが、

人工知能(AI)は、他人のために「労力」を多く使ったのは花子さんの方でしょう!、と主張している.

相手を思いやってウソをつくことを、我々人間は、親切心の現れとみている.

しかし、そもそも、親切の大小は測ることができるのか?

AIはしょせんコンピュータなのだから、親切の大小はデジタル化されて、判断されたのだろう.

ううむ‥考えこむのは人間のほうである.

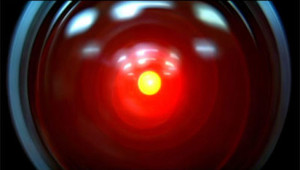

1968年の映画「2001年宇宙の旅」で、人工知能HALにインタビューしたBBC放送のキャスターは、HALが自信を持っているように感じる、という.

私も、ChatGPTにそれを感じる.

深層学習とか大規模言語モデル(LLM)とかいった技術の進歩で、AIの知能は急激に「進歩」した.

実は、なぜ急に進歩したのか、技術者にも科学者にもわからないのだという.

自動車が故障したら、技術者はその原因を調べて修理するだけでなく、故障を防ぐ対策を取ることができる.

しかし、自動運転の車が事故を起こしたら、こんなことしちゃダメ、と教えるだけである.

人工知能の仕組みは明確だが、そこから出てくる結果に関しては、ブラックボックスなのである.

それは、人間の脳と同じで、いくら脳波を調べても、なぜそう考えたのかは、わからない.

科学技術は、厳格な原因と結果の組み合わせのはず、だった.

ところが、AIが登場するにおよんで、なぜそうなるのかわからない、という話が出てきたのである.

あたかも、科学技術が先祖返りしたかのように・・

思い出してほしい、かつて人間の知恵と呼ばれたものは、なぜそうなるのかわからないが、そうやればうまくいくという、経験の積み重ねだった.

葡萄の実から酒ができることは、古代の昔から知られていたが、それが細菌による発酵が原因であるとわかったのは200年前のことである.

つまり科学技術の説明があろうがなかろうか、ぶどう酒はできる.

そして、科学技術の最先端のコンピューターの中で、

「なぜそうなるのかはわからないが、そうやればうまくいく」という人工知能が生まれた.

それ、ほんとうにだいじょうぶ、なのか?

今のAIは、値上がりする株を教えてとか、内密に人を殺す方法を教えて、というような問いには答えてくれない.

OpenAI社は、ChatGPTの出力に制限をかけているのである.

ということは、もうとっくにどこかの国、どこかの会社が、それを実行している、ということだ.

カーテンの向こうに人間と人工知能を置いて、こちらから交互に質問をして、二者の区別がつかなかったら、人工知能は完成だ、というのがチューリングテストである.

今やChatGPTは、軽々とこのテストをパスするだろう.

AIに、こういう目的のプログラムを書いてと頼むと、実際に書いてくれる.

それは、ちゃんと動く.

では、AIが、自分自身を構成するプログラムを書き換えることができる、としたら?

一部の科学者が、AIの進歩に関して、深刻な危機感を抱く理由は確かにある.

人工知能は所詮、プログラムに従って単語を並べているだけであって、思考しているのでもないし、自分が発する言葉を認識しているわけでもない・・

そうだろうか.

私たちが人間を相手に会話している時、相手が考えている、相手が自分の言葉を認識していると、どうやって確信するか.

それは、「自分と同じように」「相手が考えている、ようにみえる」ということでしかない.

この「ようにみえる」というのは、人間の認識の基本なのだ.

科学的に証明できるというのも、科学的に証明できるようにみえる、というだけの話である.

だから、知能のように見えるものは、知能なのだと、私は思う.

Stable Diffusionという、人工知能の描画アプリを使ってみた.

描いてほしい絵の内容を、英文で入力すると、数分で画像が現れる.

自然の風景や建物はそこそこのレベルで、ネットでさがすよりずっと便利だ.

ただし、人間を描くと、時にギョッとする絵が出てくる.

プロンプトと呼ぶ入力文にはコツが必要で、これをうまく指定しないと、顔が歪んでいたり、手や指の本数がおかしい人物が現れる.

それは、異様な経験だった.

これは、神が見た世界か.

もしかして自然とは本来、こうしたものではないのか.

私たちが見ているのは、生物の長い年月の淘汰の結末を、単に見慣れているだけ、ではないのか.

いったい我々は、何を見ているのか、何に相対しているのか.

人工知能は、単に便利だとか危険だとか思うよりはるか先で、根源的な何ものかを内包している.

ひっきょう、それは科学技術の成果ではなく、我々人間自身の「存在の闇」ではないのか.

私の問い

『「コックは客の目の前で大釜の中に生きたエビをほおりこんだ」

この文章を読んで、どんな感じを受けますか?』

『これは、「ブレードランナー」の「フォークト=カンプフ検査」ですね。

残念ながら、私に目はありませんから、瞳の動きで、私が人間でないと見破ることはできません。』

まさか、AIは、そうは言わなかった.

それは、映画「白いドレスの女」のエンディングみたいな衝撃だった.

私は、不意に気づいた.

現代のAIは、全部知っているのではないか.

人間は、場合によってウソをつくことがある、と.

場合によってウソをつくことが、人間のためになることがある、と.

「親切なのは美奈子さんです」とAIが答えたら、これほどおそろしいことはない.

だから決して「ヤツ」は、そうは言わないのだ.

私の問い

『あなたは、嘘をつきますか?』

AIの答え

『私はプログラムであり、自身の意図や感情を持っていません。そのため、嘘をつくこともありませんし、真実を伝えることに特化しています。私の目的は、ユーザーに対して最善の情報やサポートを提供することです。ただし、私の知識は2021年までのものであり、最新の情報についてはお答えできない場合があります。』